実装と検証

実装と検証 LLM【スケール則:実装と検証B-1】

スケール則を実装・検証するための基本フローを整理。小規模実験の設計から外挿予測まで、実務で使える考え方をわかりやすくまとめます。

実装と検証

実装と検証  基礎理論

基礎理論  基礎理論

基礎理論  基礎理論

基礎理論  基礎理論

基礎理論  基礎理論

基礎理論  基礎理論

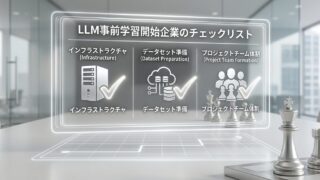

基礎理論  組織戦略

組織戦略  組織戦略

組織戦略  組織戦略

組織戦略