実装詳細

実装詳細 LLM【事前学習:実装詳細B-4】

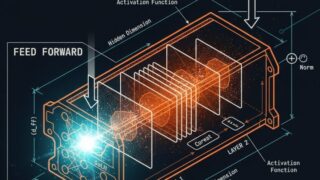

FFNと活性化関数の実装:4倍拡張MLPと非線形変換の理論Transformerモデルのパラメータの66%はFFN層に集中しています。この一見シンプルな2層MLPが、なぜこれほど大きな役割を担うのか。本記事では、FFNの詳細構造と活性化関数...

実装詳細

実装詳細  基礎理論

基礎理論  機械学習

機械学習  機械学習

機械学習