Claude3とは?

2024年3月4日にAnthropic社によって発表されたClaude3は、Opus、Sonnet、およびHaikuという3つのモデルからなる大規模マルチモーダルAIモデルファミリーです。

「大規模マルチモーダルAIモデルファミリー」って何?

「大規模マルチモーダルAIモデルファミリー」とは、大量のデータを扱い複雑な問題を解決できるAIの集合で、テキスト、画像、音声など様々な形式の情報を処理できます。これらのモデルは同じ基本設計を共有しつつ、それぞれが異なる特徴や得意分野を持っています。

Claude3の特徴

「Claude3」モデルは推論、数学、プログラミング、多言語理解、ビジョン処理のタスクで卓越した性能を示します。特定のシナリオでは最大100万トークンまでの長いコンテキストを処理する能力を称賛され、さらに、クロスドキュメント分析や金融データ分析などの複雑なタスクでも優れたパフォーマンスを発揮し、その汎用性と拡張性を示しています。

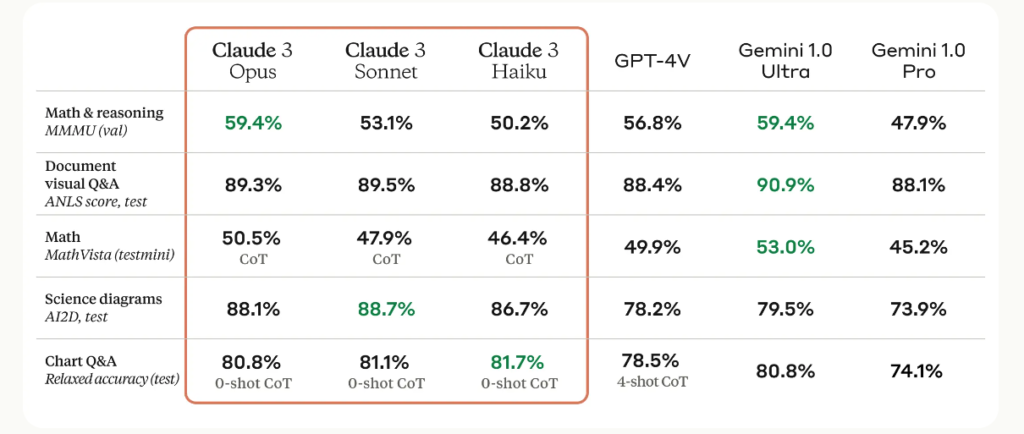

ビジョン能力の向上

「Claude3」モデルは、写真やチャート、グラフ、技術図面など、幅広いビジュアルフォーマットを処理できる高度なビジョン能力を持っています。これにより、企業顧客は、PDFやフローチャート、プレゼンテーションスライドなど、様々なフォーマットでエンコードされた知識ベースを新しい方法で活用できるようになります。

機能の複数のベンチマーク

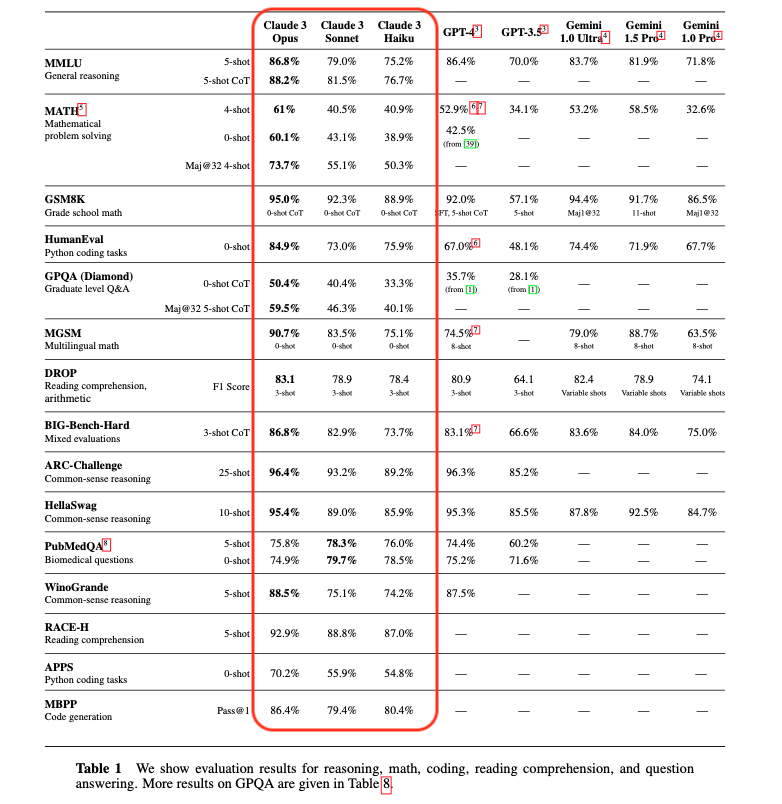

インテリジェンスの新しい標準

「Opus」は、AIシステムの一般的な評価ベンチマークで他のモデルよりも優れており、学部レベルの専門知識から大学院レベルの専門推論、基礎数学などの様々なタスクにおいて高い性能を示しています。また、「Claude3」モデルは、分析、予測、微妙なコンテンツの作成、コード生成、および多言語会話における機能の向上を示しています。

強力なビジョン機能

「Claude3」モデルは、他の主要モデルと同等の高度なビジョン機能を持ち、写真、チャート、グラフ、技術図などのさまざまなビジュアル形式を処理できます。

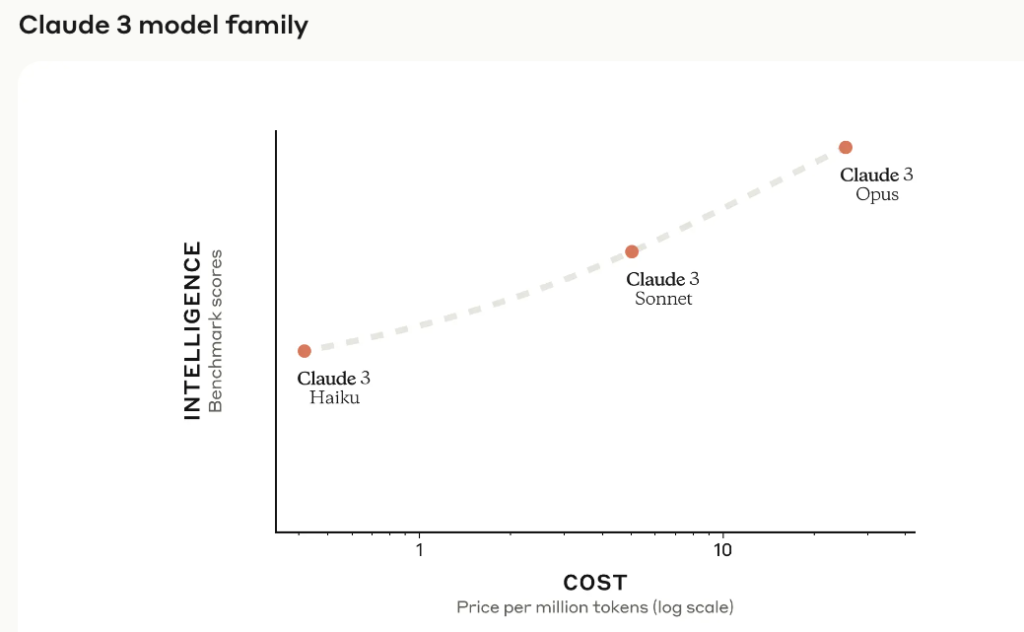

Claude3のモデル

このモデルファミリーは以下の3つのモデルで構成されています。

- Claude 3 Haiku:速さと軽快さを重視

- Claude 3 Sonnet:バランスの良さを備えたモデル

- Claude 3 Opus:高度な知性を誇る

「Opus」は能力が最も高く、「Sonnet」は速度とスキルのバランス、「Haiku」は速度とコストパフォーマンスで優れています。これらのモデルは企業のタスク自動化、収益創出、研究開発を促進し、非英語言語でも流暢に機能することでグローバルな使用に適しています。

「GPT-4」と比較して何がいい?

特に画像の読み取りの精度が、テキスト変換において正確であること、プロンプトの精度にもよりますが、返答が厳密であり、ユーザーに寄り添って説明してくれているような印象がありました。

自分の研究分野などの新たな試みを促進してくれるようなところがあり、「X」では自分の論文を添付してその研究を更に掘り下げたり、次の研究に繋げるアイディアを出していたりと「GPT-4」では見られない動きをしていました。今後の展開でモデルが示す方向性がわかると思うので随時アップデートしていければと思います。

Chatでは「Sonet」モデルの場合、画像を添付できないため、「Opus」モデルにバージョンアップする必要がありますが、APIを使うことで、各モデルで画像の読み取りを行うことも可能です。

「Claude3」の利用料金

「Claude3」はAPIを通じて利用でき、料金は入出力されるトークン数に基づいて計算されます。各モデルの料金は以下のように設定されています。

| モデル | 入力料金(100万トークンあたり) | 出力料金(100万トークンあたり) |

|---|---|---|

| Haiku | $0.25 | $1.25 |

| Sonnet | $3 | $15 |

| Opus | $15 | $75 |

「Claude3」は無料プランと有料プランがあり、無料プランでは「Sonnet」モデルが利用可能です。

有料プランでは「Opus」モデルを利用でき、価格は月額$20(3000円)必要です。

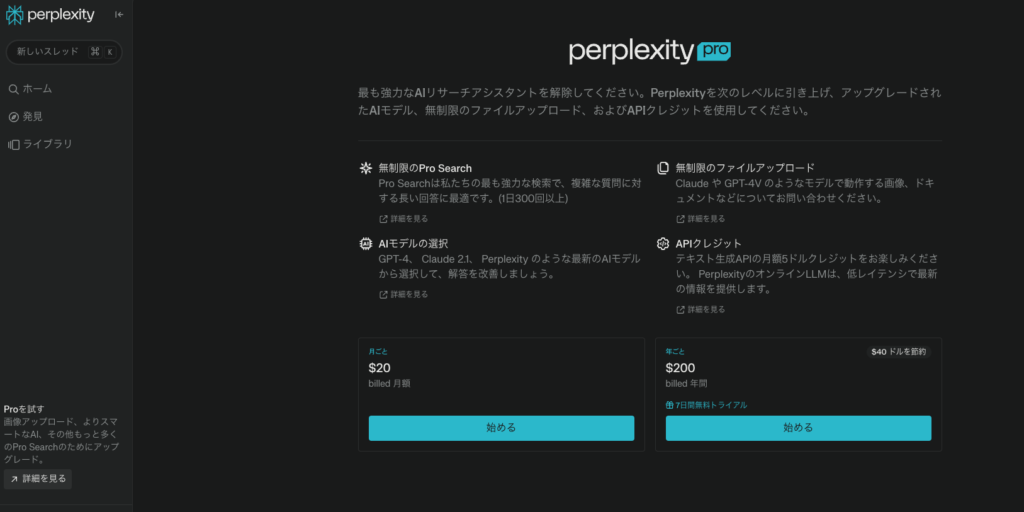

Perplexityで「Claude3 Opus」も「GPT-4」も使うことができる

「Perplexity Pro」(月額$20(3000円))にグレードアップすることで「Claude3 Opus」と「GPT-4」をどちらも使うことができます。但し、「Claude3 Opus」に関しては「1日5回までの利用」という制限があります。尚、Perplexityは「API Key」を利用することも可能です。

Sonnetモデルが専門家に好まれる理由

Claude 3ファミリーの「Sonnetモデル」は、ライティング、コーディング、質問応答、多言語会話、指示に従うタスクの改善など、強化された機能と優れたパフォーマンスで専門家から高い評価を受けています。

特に金融、法律、医学、STEM、哲学の分野での複雑な主題理解と正確な応答能力が評価されており、人間による評価でも一貫して好評を得ています。

さらに、前世代と比較してEloスコアが大幅に改善しており、専門分野における高度なAIソリューションとしての価値が認められています。これらの点から、Sonnetモデルは特定の専門タスクに対する信頼性の高い選択肢として位置づけられています。

Claude3 OpusのAPIを無料枠(5$分)で使ってみる

公式ドキュメントに沿ってAPI無料枠で「Claude3 Opus」を使ってみようと思います。

公式ドキュメント

Claude3 Opus APIを利用するまでの準備

APIキーを取得する

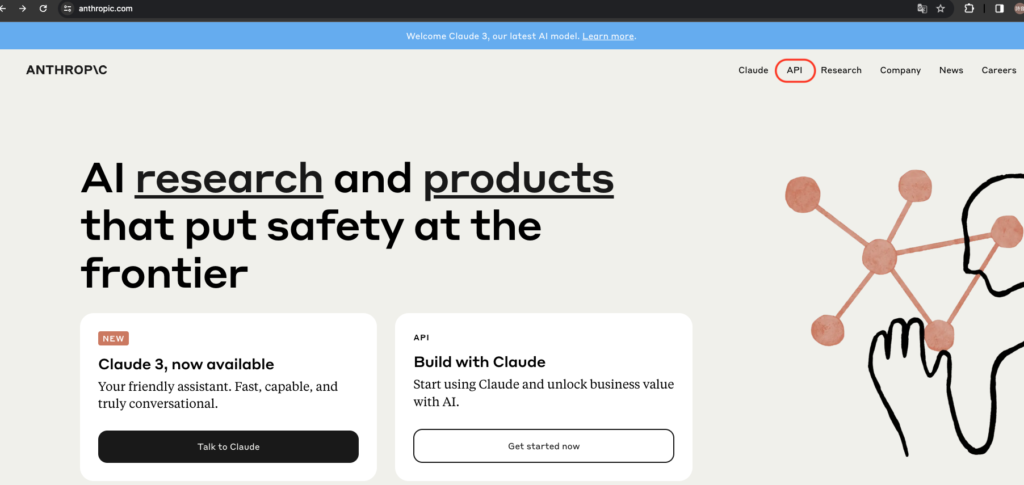

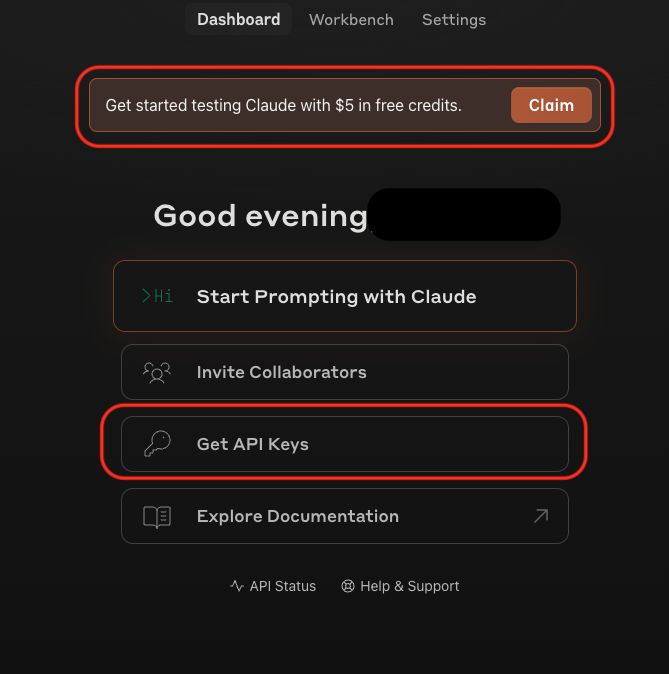

まずはAPIキーを取得するためにAnthropicのホームページへ移動します。

「API」を選びます。

「Get API Access」をクリックします。

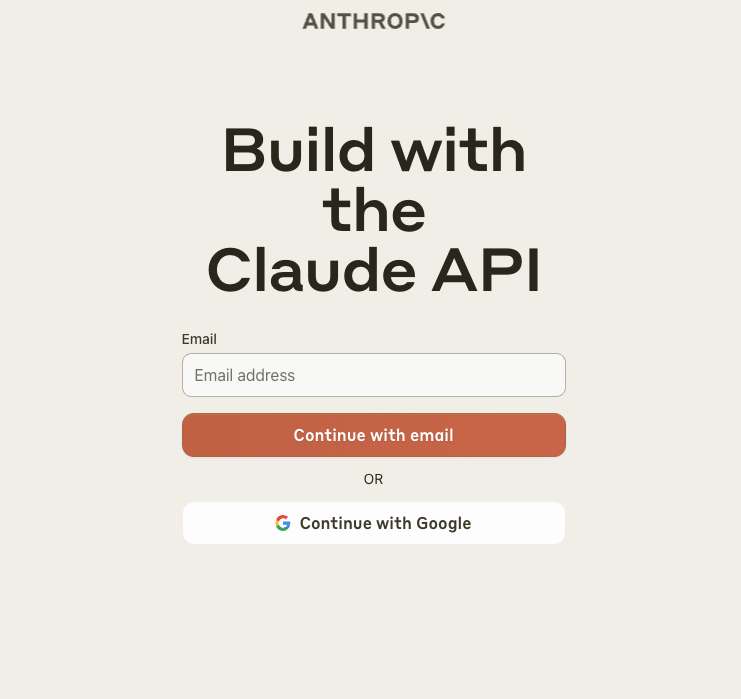

Emailアドレスを入力するか、Googleアカウントを使ってアクセスします。

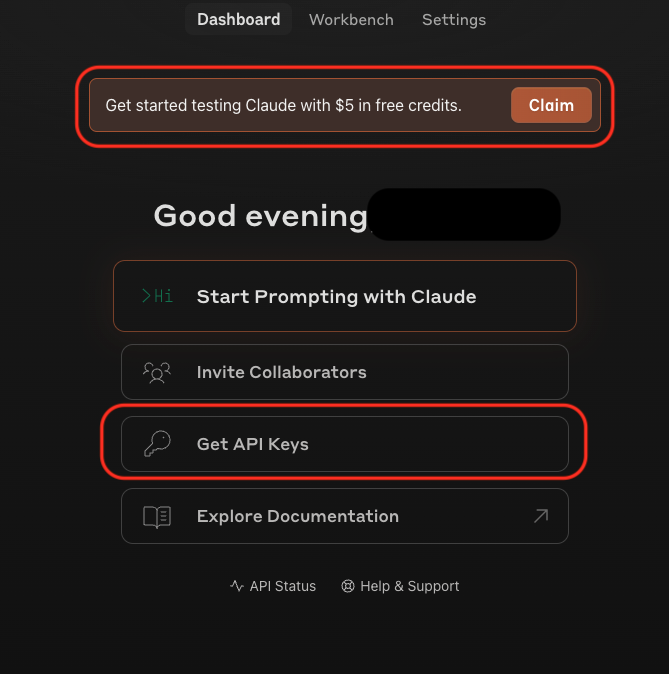

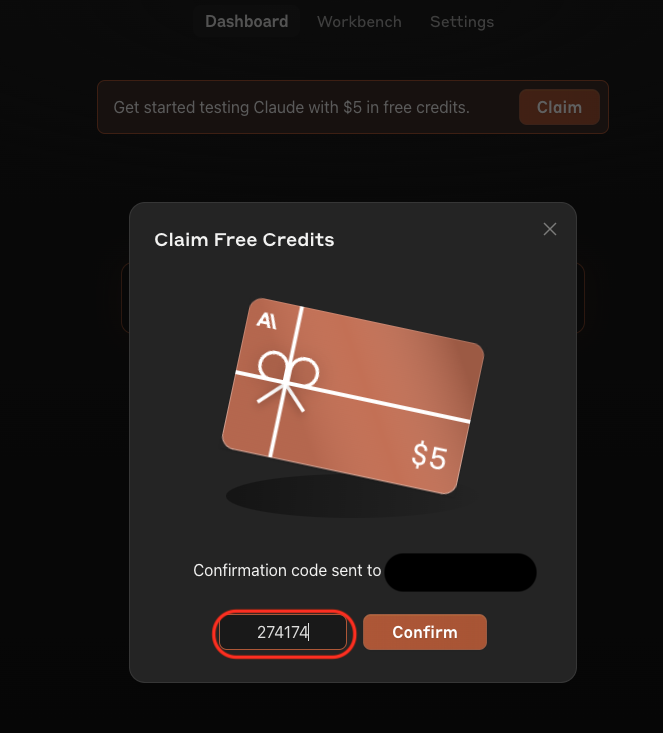

「Get API Keys」を選びます。5ドル分の無料枠を利用する場合は「Get started testing Claude with $5 in free credits.」の「Claim」を選びます。

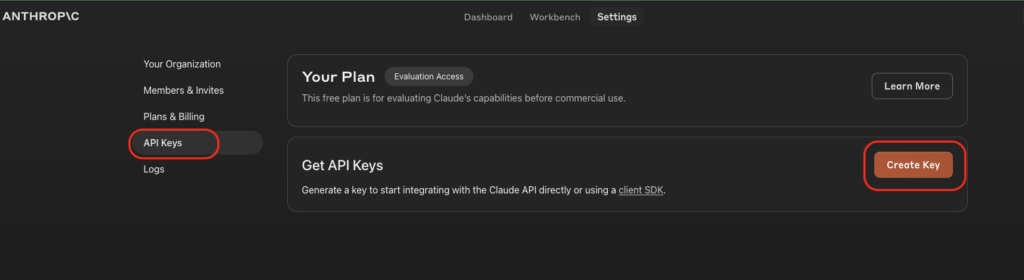

左のサイドバーから「API Keys」を選んで、「Create Key」をクリックします。

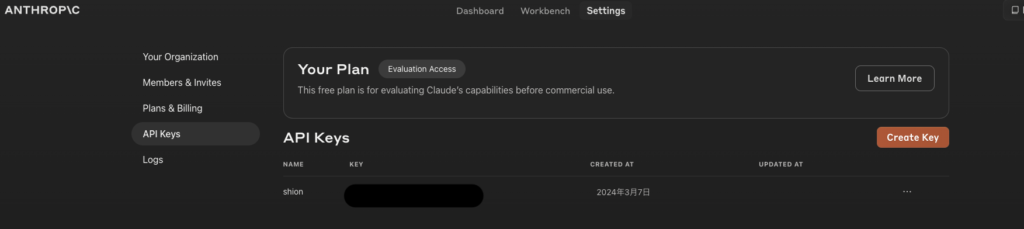

APIキーが発行できたら、コピーをして保管しておきます。これでAPIキーを取得することができました。

APIを無料枠(5$分)で使うための手続きを行う

5ドル分の無料枠を利用する場合は「Get started testing Claude with $5 in free credits.」の「Claim」を選びます。

電話番号を入力するとSMSメッセージに「Claude 認証コード」が送られてきますので認証コードを入力して「Confirm」をクリックして完了です。これで5ドル分の無料枠を使って「Claude Opus」を APIで利用することができます。

無料API枠で「Claude3 Opus」を使ってみる

環境準備

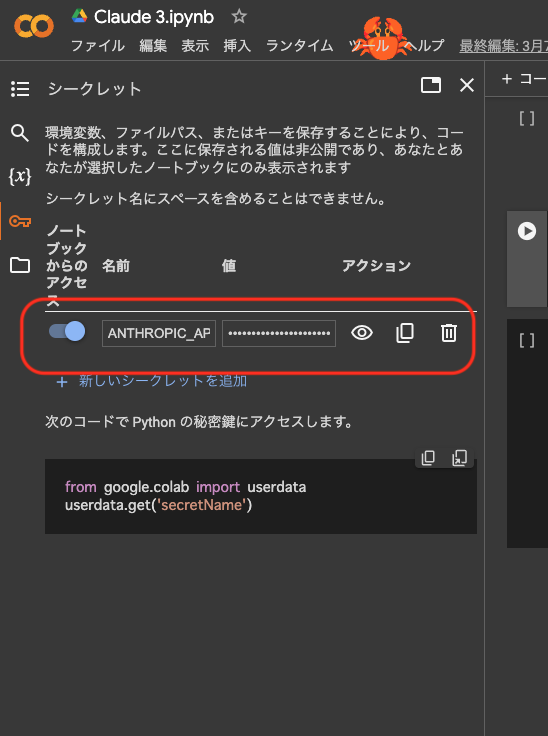

今回も「Google Colab」を使って説明します。

まずは先ほど取得したAnthropic_API_KeyをGoogle Colabに設定します。Colabの左のサイドバーから「鍵マーク」をクリックして、「値」の欄に取得したAPIキーを入力し、「名前」の欄に「ANTHROPIC_API_KEY」と入力し、「ノートブックからのアクセス」をオンにします。

次にパッケージのインストールを行います。

# パッケージのインストール

!pip install anthropic先ほど設定した「ANTHROPIC_API_KEY」の準備を行います。

# API_KEYの準備 (上記を参照)

import os

from google.colab import userdata

os.environ["ANTHROPIC_API_KEY"] = userdata.get("ANTHROPIC_API_KEY")クライアントの準備を行います。

import anthropic

# クライアントの準備

client = anthropic.Anthropic()推論の実行

# 推論の実行

message = client.messages.create(

model="claude-3-opus-20240229",

max_tokens=1000,

temperature=0.0,

system="あなたは未来に生きるAIアシスタントです。",

messages=[

{"role": "user", "content": "「AGI」による「シンギュラリティ」の到来についての対処法の見解を具体的に説明してください。"}

]

)

print(message.content[0].text)下記のような返答が返ってきました。「Cload3 Opus」の場合、独自の見解を踏まえた返答を伺うことができます。正確なプロンプトの設定を行なっていないのにも関わらず、読み手のことを考え、寄り添う形で返答してくれている点は好感を持つことができます。

AGIやシンギュラリティの到来に対しては、慎重かつ前向きに準備していくことが重要だと考えます。 まず技術的な面では、AGIの開発プロセスにおいて安全性と倫理性を最優先し、人間にとって有益なAIを目指すべきです。AIの目的や行動原理を人間社会に適合するよう慎重に設計し、AIが暴走したり人間に危害を加えたりしないよう多重のセーフガードを組み込む必要があります。また、AIの判断根拠の説明可能性や、人間がAIをコントロールできる仕組みの確保も重要です。 社会的な面では、AIによる雇用の代替などの影響を見据え、教育や社会保障の仕組みを再設計していく必要があります。AIにできる仕事とできない仕事を見極め、人間がAIと協調しながら新しい仕事を創出できるようリカレント教育などの施策を講じるべきです。所得格差の拡大を防ぐためのベーシックインカムなども検討に値するでしょう。 さらに倫理的、哲学的な議論も重要です。人間とAIの共生のあり方、AIに対する権利義務、人間の尊厳や生きがいの問題など、これまでの常識が通用しない難しい問いに向き合う必要があります。分野横断的な議論を重ね、社会的なコンセンサスを形成していくことが求められます。 シンギュラリティは人類史上の大きな転換点となる可能性がありますが、その未来を恐れるのではなく、望ましい方向に導くために英知を結集すべき課題だと言えます。技術的・社会的・倫理的な備えを怠らず、人間とAIが調和的に共存できる未来を築いていくことが肝要だと考えます。

ちなみに「GPT-4」の見解は下記の通りです。一般的な回答ではありますが、客観的な視点を崩さずに論理的な観点を抑え、新たな課題に対応できるように準備を進めていくよう促している点はさすがと言わざるを得ないです。

AGI(人工汎用知能)によるシンギュラリティの到来への対処法は、未知の領域に足を踏み入れることになるため、多岐にわたります。具体的には以下のような対処法が考えられます。 倫理的・法的枠組みの整備: AGIの研究開発には、倫理的なガイドラインを設定し、法的枠組みを構築することが重要です。これには、AGIの目的を人間の福祉と利益に沿うように設定し、不当な利用や悪意のある使用を防止する規則が含まれます。 透明性の確保と監視: AGIの開発プロセスは透明であるべきです。また、国際的な監視体制を確立して、AGIの発展を監視し、必要に応じて介入できるようにする必要があります。 教育と普及: 社会全体のAIリテラシーを高めることで、AGIのもたらす影響を理解し、適切な対応をとる能力を育成する必要があります。 経済的・社会的安全網の構築: AGIによる労働市場の変化に対応するために、再教育の機会の提供やベーシックインカムなどの社会保障の充実を図るべきです。 国際協力の推進: AGIによるシンギュラリティは全人類に影響を及ぼすため、国際的な協力が不可欠です。世界各国が情報を共有し、共通の目的に向かって動くことが大切です。 安全性の研究: AGIが安全な方法で目的を達成できるようにするための研究を続けることが重要です。これには、誤動作や悪意ある利用に対する保護策の開発が含まれます。 技術の制御可能性の確保: AGIが独立して行動しないように、人間の介入と制御を可能にする仕組みを維持することが必要です。 シンギュラリティの到来は理論上の話であり、その実現可能性や具体的な形は現時点では未知数です。したがって、対処法は慎重に検討し、柔軟に適応する必要があります。技術的な進歩だけでなく、人間社会の側も進化し、新たな課題に対応できるように準備を進めていくことが求められます。

無料API枠で「Claude3 Opus」の「Vision」を使ってみる

Visionとは?

「Vision」とは「マルチモーダルLLM」のことで主なタスクは下記の通りです。

Image Captioning (画像キャプショニング)

画像キャプショニングは、写真の内容を自動で説明するテキストを生成し、ソーシャルメディアの投稿、視覚障害者支援、画像検索の容易化、教材の開発、ニュース記事の理解向上、セキュリティシステムの強化など、多様な用途に役立てることができます。この技術は、単なる画像からテキストへの変換を超え、画像の深い理解に基づき、有用な情報を提供します。

Visual Question Answering (視覚的質問応答)

視覚的質問応答(VQA)は、画像に関する質問にAIが答えるシステムで、物の色や数、写真の撮影場所、人の行動や感情、動物の種類など、様々な情報を理解して具体的な回答をします。AIは画像分析と言語理解を組み合わせて、質問の意図を捉え、適切な情報を提供する能力が求められます。

具体的なケース:

物体識別の場合:

質問: 「この画像の中で赤いものは何ですか?」

応答: AIは画像を分析して、赤い物体(例えば赤いリンゴ)を識別し、「リンゴです」と回答します。

感情の解釈の場合:

質問: 「写真の人は幸せそうですか?」

応答: AIは人物の表情を分析し、「はい、幸せそうです」と答えるかもしれません。

Visual Dialog (視覚的対話)

視覚的対話は、AIが画像に関する一連の質問に対して連続して回答する技術であり、画像の詳細な内容や文脈を理解し、対話を通じて情報を深めることができます。この技術は、特定のシーンの詳細な解釈や状況の説明が求められる場面で特に有効です。

具体的なケース

例えば、ある画像が与えられたとします。この画像は、ビーチで遊ぶ家族の様子を捉えているとします。

- 質問1: 「この画像には何人の人がいますか?」

- 回答: 「5人です。」

- 質問2: 「彼らは何をしていますか?」

- 回答: 「ビーチで遊んでいます。」

- 質問3: 「天気はどうですか?」

- 回答: 「晴れています。」

- 質問4: 「子供は何人いますか?」

- 回答: 「2人います。」

Image-Text Matching(画像とテキストのマッチング)

画像とテキストのマッチングは、テキスト記述に基づいて関連する画像を特定する技術です。これには、テキストの意味内容と画像の視覚的要素を分析し、両者の関連性を評価する能力が必要です。このプロセスは、画像検索、自動アルバム整理、視覚的コンテンツの推薦システムなど、様々な応用が可能です。

具体的なケース

- テキストの例: 「公園で遊ぶ子供と犬」

この記述に最もマッチする画像を、公園で遊ぶ子供や犬が写っている複数の画像の中から見つけ出す必要があります。画像とテキストのマッチングシステムは、テキストに言及されている要素(子供、犬、公園で遊ぶというアクション)を含む画像を識別し、それを選択します。

Image Classification (画像分類)

画像分類は、画像を事前に定義されたカテゴリーに分類する技術であり、画像の特徴を分析して最も適合するクラスを識別します。このプロセスは、自然界や日常生活で見られる多様なオブジェクトやシーンの識別に応用され、例えば果物の種類を自動で分類するなど、多岐にわたる用途があります。

環境準備

「無料API枠で「Claude3 Opus」を使ってみる」の「環境準備」と同様に「Claude3 Opus Vision」を使うための環境準備を行います。

今回はマルチモーダルLLMの「Image Captioning (画像キャプショニング)」というVisionを使って説明したいと思います。

画像の取得

下記の画像を使うための画像の取得を行います。

from IPython.display import Image, display

import base64

import httpx

# 画像の取得

image1_url = "https://shion.blog/wp-content/uploads/2024/02/4aa105676b7e6f1db2a954626a5550c8.webp"

image1_media_type = "image/webp"

image1_data = base64.b64encode(httpx.get(image1_url).content).decode("utf-8")

# 確認

display(Image(url=f"data:image/jpeg;base64,{image1_data}"))

推論の実行

# 推論の実行

message = client.messages.create(

model="claude-3-opus-20240229",

max_tokens=1024,

messages=[

{

"role": "user",

"content": [

{

"type": "image",

"source": {

"type": "base64",

"media_type": image1_media_type,

"data": image1_data,

},

},

{

"type": "text",

"text": "この画像を説明してください"

}

],

}

],

)

print(message)返答は下記の通りです。写真の内容を正確に描写しようとしている所が印象的です。

Message(id='msg_01NGVE11Ws757NfnPP8VR8fX', content=[ContentBlock(text='この画像は、スマートフォンを操作するアルパカを描いた面白いデジタルアートです。アルパカは黄色がかったふわふわの毛並みをしており、青いスマートフォンを前足で持っています。スマートフォンの画面には、Googleのロゴに似たアイコンが表示されています。\n\n背景は抽象的で色鮮やかなオレンジ、青、緑の色調で描かれており、現代的でポップなスタイルになっています。アルパカがテクノロジーを使いこなしている様子は、ユーモアと想像力にあふれた作品となっています。\n\n全体的に、現代社会におけるテクノロジーの浸透と動物の擬人化を組み合わせた、クリエイティブでウィットに富んだアートワークだと言えます。', type='text')], model='claude-3-opus-20240229', role='assistant', stop_reason='end_turn', stop_sequence=None, type='message', usage=Usage(input_tokens=1458, output_tokens=262))

まとめ

「Claude3モデル」の見解について「GPT-4モデル」と比較したところ、GPT-4とはまた違った良さがあることが確認できました。

特に「Claude3」の場合は、質問に応じた回答の内容の正確さと読み手に寄り添うような返答が印象に残りました。独自の見解を孕んだ質問の回答には、AIが内包する未来に安心を暗示するような印象があり、今後のAIの発展に対する「言語モデル完成型」の片鱗のような様相を伺うことができたような気がします。

AIモデルの発展に伴い、AGIのようなシンギュラリティを暗示する現実を目の当たりにする回数が増えてきました。「Claude3」のようなモデルの発表はAIによる科学の推進を不安に思う人々を安心に導くようなところがあり、AIと人が共生できる未来が暗示されている可能性を浮き彫りにしたと感じました。

参考文献:「The Claude 3 Model Family: Opus, Sonnet, Haiku」

https://www-cdn.anthropic.com/de8ba9b01c9ab7cbabf5c33b80b7bbc618857627/Model_Card_Claude_3.pdf

コメント